KI-Penetrationstests

Argus AI Sicherheit

Wir sehen in die Zukunft

Mit Argus AI Red finden Sie einen Partner, der Sie dabei unterstützt, das Potenzial der KI-Technologie voll auszuschöpfen und Wachstum und Innovation in Ihrem Unternehmen zu fördern.

Informationssicherheit

Adversarial Machine Learning

Künstliche Intelligenz (KI) hat das Potenzial, viele Branchen zu revolutionieren und die Art, wie wir leben und arbeiten, zu verändern. Mit der fortschreitenden Entwicklung der KI wachsen jedoch auch die Herausforderungen, denen sie sich stellen muss. Eine der wichtigsten davon ist Adversarial Machine Learning (AML).

Beim AML-Verfahren wird ein KI-System mit Eingabedaten gefüttert, die es dazu bringen sollen, eine falsche Entscheidung zu treffen. Dies geschieht häufig durch das Hinzufügen kleiner, sorgfältig ausgearbeiteter Störungen zu den Eingabedaten, die für den Menschen nicht erkennbar sind, aber das KI-System zu Fehlverhalten veranlassen.

Wer? Warum? Wie?

Die Bedrohung verstehen

Um sich gegen AML zu verteidigen, ist es entscheidend, das wer/warum/wie der Bedrohung zu verstehen, um die richtigen Schritte zu unternehmen, damit Ihr Unternehmen sicher ist. Die Entwicklung von KI-Systemen, die robust und in der Lage sind, gegnerischen Angriffen zu widerstehen, ist von entscheidender Bedeutung für den langfristigen Unternehmenserfolg. Dies kann durch eine Vielzahl von Maßnahmen geschehen, die auf das spezifische Bedrohungsszenario Ihres Unternehmens abgestimmt sind.

AML ist ein wachsendes Problem in der KI-Gemeinschaft, denn es bezieht sich auf die Fähigkeit von Angreifern, KI-Systeme zu manipulieren und sie zu falschen Entscheidungen zu veranlassen. Dies kann schwerwiegende Folgen haben, z. B. die falsche Einstufung eines gefährlichen Objekts als gutartig oder eine falsche Betrugserkennung.

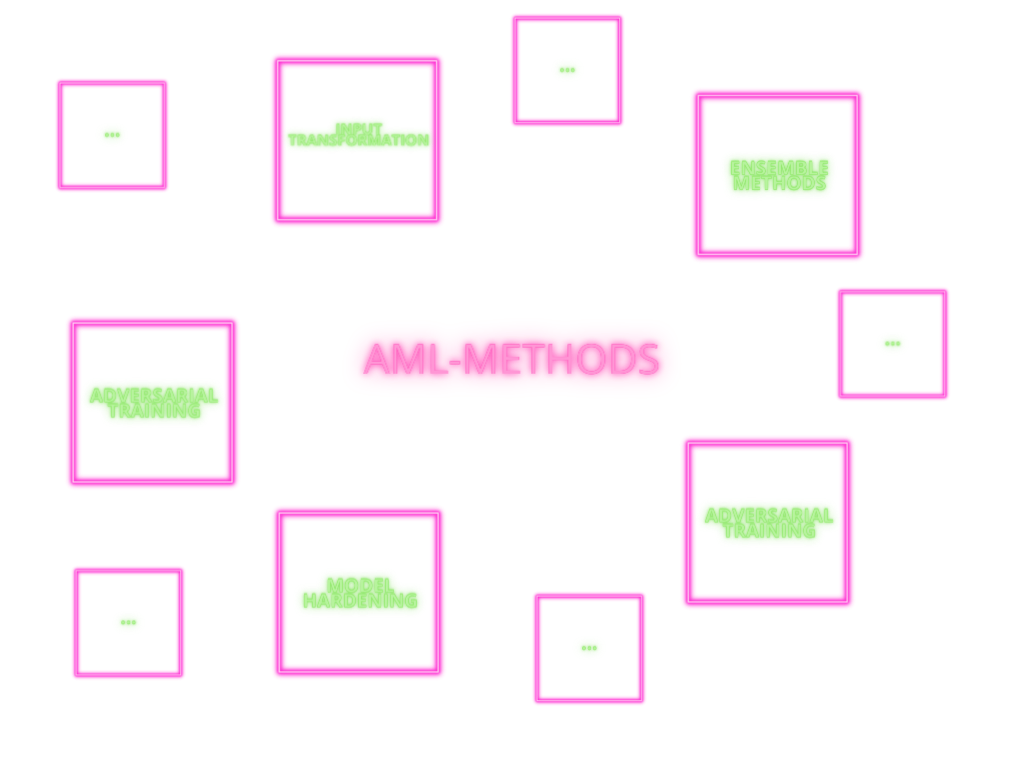

AML-Methoden

Das Modell verstehen

Bei Argus AI haben wir einen Großteil unserer Zeit damit verbracht, uns mit dem „Wie“ der Bedrohung zu beschäftigen. Wie können Algorithmen gebrochen, ausgetrickst und manipuliert werden und was lässt sich aus diesen Erkenntnissen für die weitere Entwicklung von Machine-Learning-Modellen gewinnen. Das Verständnis des Modells und der zugrundeliegenden Architektur, schafft die Möglichkeit, Angriffsstrategien zu antizipieren und sie proaktiv einzusetzen, um die Robustheit des Unternehmens zu verbessern.

Kombinieren Sie robuste KI-Leistung mit organisatorischer Exzellenz

Organisation der Sicherheit

KI-Sicherheit ist eine dynamische Herausforderung, die ständige Wachsamkeit gegenüber Bedrohungen wie feindlichen Angriffen, Data Poisoning und Modellausnutzung erfordert. Um diese effektiv zu bekämpfen, müssen Unternehmen über Tools und Modelle hinausgehen und ein KI-Bedrohungsteam einrichten, das nahtlos in ihren Betrieb integriert ist.

Dieses Team ist für die proaktive und reaktive Sicherheit unerlässlich. Sie überwachen KI-Systeme in Echtzeit, identifizieren Anomalien und reagieren schnell auf neue Bedrohungen. Über die unmittelbare Verteidigung hinaus analysieren sie Schwachstellen, kontern gegnerische Taktiken und entwickeln Sicherheitsprotokolle, um potenziellen Angreifern einen Schritt voraus zu sein. Ohne ein eingebettetes Team riskieren Unternehmen fragmentierte Arbeitsabläufe, verzögerte Reaktionen und gefährdete KI-Ressourcen.

Argus AI ist Ihr zuverlässiger Partner beim Aufbau dieser wichtigen Fähigkeit. Wir arbeiten mit Ihnen zusammen, um Prozesse und Teams zu entwickeln, die auf die Bedürfnisse Ihres Unternehmens zugeschnitten sind. Unser Fachwissen reicht von der Ermittlung der erforderlichen Fähigkeiten und der Integration fortschrittlicher Überwachungstools bis hin zur Schaffung von Arbeitsabläufen, die eine nahtlose Zusammenarbeit zwischen IT, Data Science und Betrieb gewährleisten.

Mit Argus AI kann Ihr Unternehmen seine Widerstandsfähigkeit in einer sich ständig verändernden Bedrohungslandschaft verbessern. Indem Sie die KI-Sicherheit in Ihre Kernprozesse einbinden, schützen Sie Ihre KI-Investitionen und schaffen Vertrauen bei Kunden und Stakeholdern. Sichern Sie Ihre KI-Systeme noch heute mit der Beratung und Expertise von Argus AI.

Schützen Sie Ihre Systeme vor LLM-Manipulation und Prompt Injection

LLM-Bedrohungen

Machen Sie Ihre KI-Systeme schon heute mit Argus AI zukunftssicher – denn den Bedrohungen voraus zu sein, ist die beste Verteidigung.